����ժҪ�����ż���������硢AI�ȼ����Ŀ��ٷ�չ,�˻�������Ϊ���ܡ����ܻ�������������������еõ�Խ��Խ�㷺��Ӧ�á�������û�����������һ�����н���,��ɽ�һ���ı��˻�֮��Ľ�����ϵ�����˻�������,��������ʶ���Dz��ɻ�ȱ����Ҫ���ڡ����ڴ�,���Ĵ���������ʶ��ķ��������̷�������,�������˻���������������ʶ���ʵ��;����

�����ؼ��ʣ��˻�����; ��������; ʶ��;

����Research on Face Expression Recognition in Human-Computer Interaction

����LU Yu

����������֮���ڽ��н�����ͨʱ,��ʹ��һЩ��Ϊ�������沿������������Ӧ�����ݡ����������ǿ���ʶ��������沿����,�����ݱ�������˵�����,���ܹ�ʹ�������̱�ø�����Ȼ��ȷ�����,���˻������е���������ʶ������о��Ե���Ϊ��Ҫ��

����һ����������ʶ��ķ���������

�����˻��������HCI[1],�����ܻ��������û�����˫����Ϣ����Ĺ��̡�Ϊʹ������ø�����Ȼ��ȷ,��Ҫ�����ܻ�����ʶ������ĸ��������Ϣ,��ϲŭ������˼�ֵ�,���ݴ����������ķ���������һĿ���ʵ����,Ҫ���õ���м���,��AC,������ָͨ���������ܻ�������������Ƶĸ����������,�Ӷ�ʵ�ֻ��������������Ȼ����[2]��Ҫ��ʵ�����ܻ����˵����˻�,�ͱ���ʹ���ܹ�ʶ��������沿��������Ե�,����֪������������״̬,���ݴ�������Ӧ����������ʶ��,���FER[3],��һ���ж����������Ϊֱ�ӵķ���,���������˻����������в��ɻ�ȱ����ɲ���֮һ,���һ�������ʶ���������Ҫ�о����⡣

����(һ)��������ʶ��

����Ŀǰ,��������ʶ���ɷ�Ϊ����,һ���Ǿ�̬ͼ��ʶ��,��һ���Ƕ�̬ͼ��ʶ��ǰ�߰������巨���ֲ����ͼ��η�,����,���巨�ܹ������ؼ����ص���Ϣ���п�����ȡ;�ֲ�����ʶ������Խϸ�;���η���Ȼ��λ���ȱȽϸ�,������ͼ�����������Ƚϲ�,���DZ������ڸ���ʱ,����ȷʶ�𡣺��߰�����������ģ�ͷ�,����,�������������κγ�����Ϣ��ǰ��������ȷ�����˶�������;ģ�ͷ���õ������������д�����,����ģ���̷����Ҽ������Ƚϴ�

����(��)��������ʶ������

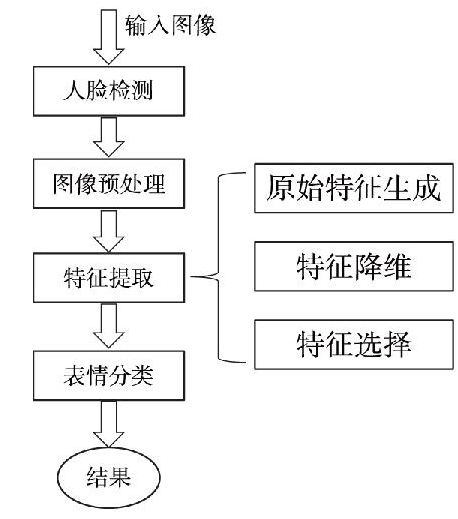

������������ʶ����һ����ԱȽϸ��ӵĹ��̡�����Ŀ��,��ͼ1��ʾ[4]��

��

����ͼ1 ��������ʶ����ʾ��ͼ

��������������ʶ�������,��һ���dz��ؼ��Ļ���,���沿������ȡ�����ò�ͬ����ȡ����,���õ���ʶ��������һ���IJ��졣���,������Ҫ��ȡ������,ѡ����Ӧ����ȡ��������������ʶ�������֮�ء������Ͽɽ���������ʶ��Ϊ��⡢ͼ������������ȡ�Լ�������༸��ģ�顣����,���ģ���ܹ���ȡ��������ͼ����������λ��,�����õ�����ͼ��ͼ����ģ��ὫһЩӰ������ȥ����,���������ȡģ���Դ����õı�������������ȡ���ں�,������뵽�������ģ�鵱��,�ɷ��������ʶ������

���������˻���������������ʶ���ʵ��;��

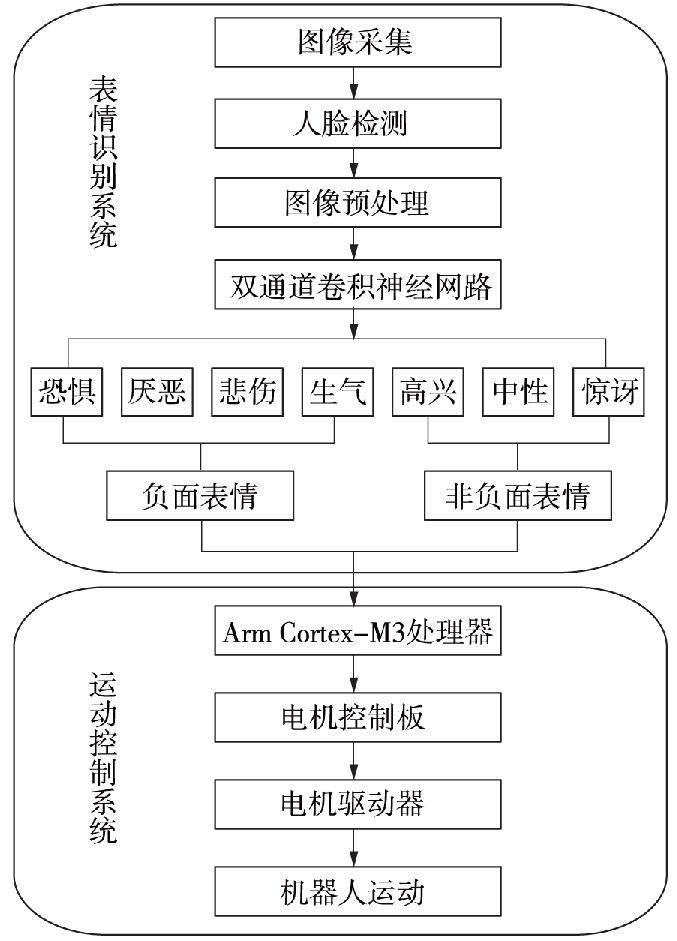

����(һ)��������ʶ��ϵͳ����ܹ�

�����ڷ����������,��������ʶ��ϵͳ��Ϊ��λ��(��������ʶ��ϵͳ)����λ��(����������˶�����ϵͳ)������ϵͳ������,��λ����Ҫ���������������ʶ����,��ͼ��ɼ������������Ԥ������������ȡ��ʶ�𡢱������ָ����ģ�鹹�ɡ�����ģ�鼯�ɺ������ϵͳ���,��ͼ2��ʾ��

��

����ͼ2 ϵͳ��ܽṹʾ��ͼ

������λ������EP(Ƕ��ʽ������),Ϊ�����������ʶ�����ṩ����ƽ̨����ϵͳ��������Ϊ:���Զ�����������,����ͷ������ɼ�ͼ��,����AdaBoost��������㷨�ڴ����ͼ����ȷʶ����������,Ԥ������������;���þ���������ʶ���������,�Ի��Ѷ����ۺ�Ч�۶�����Ϊ����,�Ա������ͽ��л���,��������������ˡ��־�(�������ֱ������Ϊ�������),�Լ����ȡ����ԡ�����(�������ֱ���Ϊ�Ǹ������);�ڱ�������,���ݲ�ͬ�ķ��������ò�ͬ���˻�������ʩ,���ʶ����ĸ�������´�“move”ָ��,����ָ��䵽��λ��,���ʶ����ķǸ�������´�“stop”ָ��,��ִ��ѯ�ʹ���,����Զ�����н���,���������������ʶ����������̡�

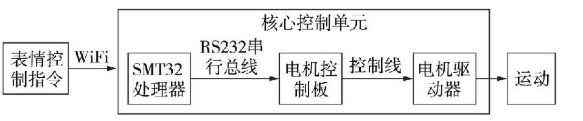

������λ��(����������˶�����ϵͳ)�Ľṹ,��ͼ3��ʾ,��Ҫ�ɴ������������������������ư��ģ�鹹��,�书����Ҫ����ִ����λ�������ָ���ϵͳ�IJ�������Ϊ:ϵͳ���պʹ�����λ�������ָ��,��RS232���������д���ָ������,�������ģ����մ������ָ��,�������ִ�������������������,���������ͨ������չ������������յĿ����ź�,�������˽��յ������ź�֮��,������Ӧ���˶���

��

����ͼ3 �˶�����ϵͳ�ṹʾ��ͼ

����(��)ϵͳ����

����Ϊ�Ա�����������ϵͳ���ܽ��м���,������������ʶ�����������֮�乹����������,�����˰��������������ͨ����ص�ʵ������,�Ը�ϵͳ��ʶ�����Լ�ʵʱ�Խ�����֤��

����1.ϵͳ��ʶ����

�����ڶԱ����������ϵͳ�ȶ��Լ�³���Խ�����֤�Ĺ�����,ѡȡ����λ������(һ��һŮ)�ı���ʶ������Ϊ�����֤�����ȷ�ԺͿ��Ŷ�,�����ߵ�ÿ�������ͳ��100֡����ͼ��,��������ʶ������֡�����м�¼,�Դ�������ϵͳ����������ʶ���ʡ�

����2.ʵʱ������

��������������ʶ���ʵʱ�Խ�������,ͨ������100֡������ͼ��ķ�ʽ,ͳ�Ʊ���ʶ���������������ʱ��,�Լ����ֻ�Զ�����������ʱ����в��ԡ�����ʵ��������ʾ:����ʶ���˶����ƺ�ʱΪ1.32s,��Ƚϴ�ͳ����������ʶ��ϵͳ����,����ʱ�����ӳ�������ԭ�����ڱ���ʶ��֮����ͨ�����ߴ����ź�,�����õ�������ķ�ʽ��ʹ�˶�����,��һ��������ʱ��ϳ�,���±���ʶ�����ʵʱ���½���ͬʱ,�ڻ������˶�������,�����ܵ����ָ�������Ӱ��,��һ������ʵʱ��;�ֻ�Զ�����Ӻ�ʱΪ1.19s,��1.32s��0.13s,˵�������Ե���������ʶ��ϵͳ�������õ�ʵʱ��,��������������ʶ��ϵͳ��

����3.�˻�������

���������˻���������,ϵͳʶ��������,�ᷢ��ѯ��,����Զ�����н���,��ѯ��“����ô��?���ܰ�������?”��ʶ�Ǹ�������ʱ,ϵͳ��Ȼ�ᷢ������,��“���������ܸ���”��

��������ʵ������ʾ,��ϵͳ����ɱ���ʶ�����,�߱����õ�ʶ��ʵʱ�ԺͲ����ȶ��ԡ��ں����о���,Ӧ������ʶ���������������������õ��˻�������,�ḻ�˻������Ĺ���,ʹ�˻��������̸���˳��,�Ӷ������Զ���������õĽ������顣

������������

������������,Ϊʹ�˻��������̱�ø�����Ȼ��ȷ,���ܻ�������Ҫ�������������ʶ��Ϊ���ʶ����,������������������㷨���ݴ�,���Ŀ�����һ����������ʶ��ϵͳ,��ϵͳ��Ӳ�����������з���,��ͨ��ʵ��ķ���,��ϵͳ��ʶ���ʺ�ʵʱ�Խ�����֤,���ս������,��ϵͳ�ܹ�������ʵ������Ӧ����Ҫ��

���������

����[1] ������.�ں����ѧϰ��ϡ���ʾ����������ʶ���о�[J].�Զ���������Ӧ��,2019(10):109-111.

����[2] ������,����,κ��.���ھ����������ں�SIFT��������������ʶ��[J].�����Ӧ��������,2019(11):143-146.

����[3] Ҧ��ɯ,�ž�ί,����,��.����LBP��SVM����������ʶ��ϵͳ�������ʵ��[J].����ʦ����ѧѧ��(��Ȼ��ѧ��),2020(1):87-92.

����[4] ��F��,��Сϼ,��ѧԨ,��.���ڶ�߶Ⱥ����������������ʵʱ��������ʶ��[J].�����Ӧ��,2019(9):2568-2574.