摘 要

随着我国经济的发展和科技的进步,拥有汽车的家庭也随之增多,虽为生活提供了更多的便利,但伴随而来的还包括道路拥挤和交通事故,汽车的驾驶安全已成为当下汽车技术发展所面临的一个重中之重的问题。基于双目视觉的环境感知技术在汽车安全驾驶领域中是一个研究热点,本文对基于双目视觉的目标检测与测距进行了深入研究,提出了一种基于深度学习网络 GA-Net 和YOLOv4 的目标检测与测距技术。

首先,对摄像机几何成像中用到的四大坐标系和它们之间的转换关系进行介绍。分析了双目立体视觉测距的原理,然后总结了常用的匹配算法。

其次,对 GA-Net 立体匹配的原理、网络结构和实现过程进行分析,采用KITTI-stereo2015 和 Cityscapes 两个数据集进行训练和测试,将获取的视差图与传统 SGM 算法获取的视差图进行了比较,结果表明 GA-Net 立体匹配算法处理得到的视差图更平滑,边缘更清晰,在均方根误差上也明显低于 SGM 算法。

再次,研究分析了 YOLOv4 模型的算法原理、网络结构、损失函数等,采用 MS COCO 数据集训练模型、KITTI-Object 的训练集微调模型参数、KITTI-Object 的测试集和 Cityscapes 测试集测试模型,利用平均检测精度(AP)、均值平均精度(m AP)和图像每秒传输帧率(FPS)三个指标评估 YOLOv4 模型的识别性能,并将结果与 SSD 目标检测模型作比较。

最后,采集室内和室外的双目图像视频。运用张正友标定法对选择的 ZED双目相机进行标定得到内参、外参信息,然后采用单目标和多目标的检测与测距方案对本文提出的目标检测与测距算法进行试验,单目标检测和测距的试验结果表明在 15 m 距离范围内,目标测距误差在 5.2%以内;多目标检测和测距的试验中,本文的算法正确识别了图像中的人、车、椅子等信息,并计算出了它们的距离。

多种试验的结果表明,本文提出的基于双目立体视觉的目标检测与测距技术可以为汽车自动驾驶提供辅助驾驶技术。

关键词 : 双目视觉;目标检测;测距;自动驾驶 。

Abstract

With the development of my country’s economy and technological progress, thenumber of families with cars has also increased. Although it provides moreconvenience for life, it is also accompanied by road congestion and traffic accidents.

Car driving safety has become the current situation. One of the most important issuesfacing the development of automobile technology. The environment perceptiontechnology based on binocular vision is a research hotspot in the field of car safedriving. This article conducts in-depth research on target detection and ranging basedon binocular vision, and proposes a deep learning network based on GA-Net andYOLOv4 Target detection and ranging technology.

First, the four coordinate systems used in the geometric imaging of the cameraand the conversion relationship between them are introduced. The principle ofbinocular stereo vision ranging is analyzed, and then the commonly used matchingalgorithms are summarized.

Secondly, the principle, network structure and implementation process ofGA-Net stereo matching are analyzed. Two data sets of KITTI-stereo2015 andCityscapes are used for training and testing. The obtained disparity map is comparedwith the traditional SGM algorithm. The result is It shows that the disparity mapprocessed by the GA-Net stereo matching algorithm is smoother, the structure isclearer, and the root mean square error is also significantly lower than the SGMalgorithm.

Thirdly, it studied and analyzed the algorithm principle, network structure, lossfunction of YOLOv4 model, using MS COCO data set training model, KITTI-Objecttraining set to fine-tune model parameters, KITTI-Object test set and Cityscapes testset test model, using Average detection accuracy (AP), average average accuracy(m AP) and image frame rate per second (FPS) are three indicators to evaluate therecognition performance of the YOLOv4 model, and compare the results with theSSD target detection model.

Finally, collect indoor and outdoor binocular images and videos. Use ZhangZhengyou calibration method to calibrate the selected ZED binocular camera toobtain internal and external parameter information, and then use single-target andmulti-target detection and ranging schemes to test the target detection and rangingalgorithm proposed in this paper. Single target detection and The test results ofranging show that within the range of 15m, the target ranging error is within 5.2%; inthe multi-target detection and ranging test, the algorithm in this paper correctlyrecognizes the information of people, cars, chairs, etc. in the image, and calculatesOut of their distance.

The results of various experiments show that the target detection and rangingtechnology based on binocular stereo vision proposed in this paper can providedriving assistance technology for auto-driving.

Keywords : binocular vision, target detection, distance measurement, automaticdriving 。

第一章 绪论

1.1 、 研究背景 。

随着社会现代化水平的不断提高,汽车已成为家庭出行的重要一部分。汽车普及带来的各种问题愈发引人关注。如大量的汽车在街道上造成的严重堵车问题,还有最重要也最引人关注的交通安全问题。现如今我国拥有了世界最长公里数的高速公路,同时我国还是汽车使用大国,不断增加的交通事故也造成了大量的经济损失,因此不断提高汽车的智能程度则是解决该问题的一种必要途径。人、车和路三者构成了一个既复杂又多变的系统,若想通过解决道路来缓解损失需要投入大量的人力、物力和财力,所以在本着效益最大化的前提下,快速解决此问题的有效方法就是提高车辆的智能化,汽车的自动驾驶功能也是汽车智能化的一个分支。

目前,具备自动驾驶功能的汽车已具有导航技术、通信技术、自动泊车技术、自动避障技术等其他技术,在一定程度上有效减少了交通安全带来的压力。

环境感知技术对汽车的自动驾驶技术的发展而言是至关重要的,若给汽车配备一定的传感器[1]

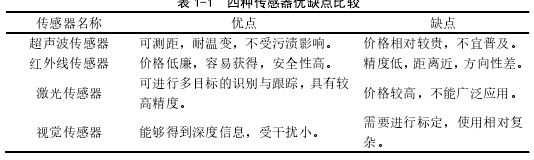

来代替人的双眼,检测前方目标,实现所有的视觉功能,对提高汽车的自动驾驶功能有很大的帮助,也可以推进车辆智能化发展的趋势。目前常见的几种传感器的优缺点如表1-1所示。

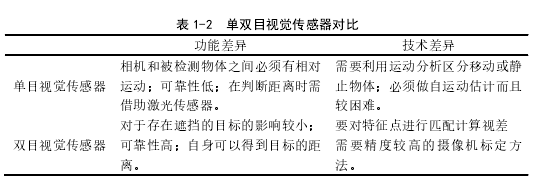

通过表1-1可知,视觉传感器对于采样信息能够得到很好的保存,受干扰的可能性小,在对前方目标的检测技术中发挥着重要的作用。可以将它分为单目和双目,其功能与技术差异对比如表1-2所示。

经表1-2比较可知,和单目视觉传感器相比较,双目视觉传感器具有更好的测距和识别效果。本文选取双目相机作为视觉传感器。

1.2 、 研究意义 。

目前我国智能化车辆在军事领域和民用汽车领域上均有广泛应用。在军事领域上,当部队在野外进行某些军事活动时,使用智能车辆可以在一定程度上降低任务的风险,减少不必要的损失;在民用汽车上,智能车辆可以提供辅助驾驶功能即自动驾驶,从而提高驾驶员驾驶汽车的安全性。目前,很多汽车品牌已经将自动驾驶技术配备到正在研发的汽车中,受到了消费者的青睐。为了使得车辆的自动驾驶功能得到更好的发展,提高其自动驾驶的能力,就要提高对车辆前方目标的检测与测距能力。

为了使得车辆在自动驾驶方面具有一定的可靠性,需要应用鲁棒性较强的目标检测与测距技术。驾驶员在驾驶汽车的过程中,通过视觉传感器代替人眼获取前方的环境信息,进而判断汽车前方目标的位置和距离信息,然后将前方存在的目标的相关信息提示给驾驶员,让驾驶员及时做出判断,由此可以在一定程度上降低交通事故发生的概率。未来,实现高精度的目标检测与测距技术不仅可以为汽车自动避障功能提供扎实的基础,还可以为汽车的路径规划技术做准备。因此对汽车的自动驾驶技术来说,研发车辆前方目标的检测与测距技术具有重要的意义。

对于自动驾驶和无人驾驶来说,认知主体是它们之间最大的区别。对自动驾驶而言,驾驶员是它的认知主体,而无人驾驶的认知主体则完全为机器,没有驾驶员参与。无人驾驶是自动驾驶发展的最终目的,因此对车辆前方目标进行检测与测距对无人驾驶技术的发展来说也有着至关重要的作用。

【由于本篇文章为硕士论文,如需全文请点击底部下载全文链接】

1.3、国内外研究现状

1.3.1、双目视觉智能车研究现状

1.3.2、双目视觉立体匹配技术研究现状

1.3.3 、目标检测技术研究现状

1.4、本文主要研究内容与结构安排

第二章 双目视觉及立体匹配基础理论

2.1、摄像机几何成像模型.

2.1.1、 四大坐标系

2.1.2、坐标系的转换

2.1.3、 非线性模型

2.2、极线几何.

2.3、双目立体视觉测距的原理

2.4、立体匹配算法,

2.4.1、传统的 立体匹配算法

2.4.2、基于卷积神经网络的立体匹配算法

2.5、立体匹配算法评价标准.

2.6、本章小结.

第三章 基于GA-Net的立体匹配.

3.1、 GA-NET 立体匹配

3.1.1、网络结 构

3.1.2、特 征提取

3.1.3、代价聚合

3.1.4、引导子网络.

3.1.5、视差回归与损失函数

3.2、试验过程与试验结果分析.

3.2.1、试验 数据集

3.2.2、训练过程

3.2.3、试验结果与 分析.

3.3、本章小结.

第四章 目标检测

4.1、 YOLO目标检测算法

4.1.1、 YOLOv4 目标检测

4.1.2、网络结 构

4.1.3、损失 函数

4.2、目标识别训练.

4.2.1、试验数据集

4.2.2、模型的训练

4.2.3、检测性能评估指标

4.3、试验结 果与分析

4.4、本章小结.

第五章 基于双目立体视觉的目标检测与测距试验.

5.1、试验平台

5.2、摄像机标定

5.3、实测图像集测试结果

5.4、本章小结.

第六章 总结

本文以双目立体视觉和目标检测技术为基础,在不同背景下研究了对车辆前方目标的检测识别与测距技术,该技术可以为自动驾驶的汽车提供前方信息,促进汽车自动驾驶技术的发展。通过在计算机搭载双目摄像机,采集真实的图像视频信息,运用深度学习算法检测识别前方目标,再通过立体匹配算法计算目标的距离,实现车辆自动驾驶中对前方目标的检测识别与距离计算。

结合实现双目立体视觉目标识别与测距系统所做的工作,本文主要完成的内容及结论如下:

(1)首先查阅了大量的目标检测算法与立体匹配算法的文献,并介绍了目标检测识别和立体匹配的研究现状。

(2)通过分析世界坐标系、摄像机坐标系、图像像素坐标系、图像物理坐标系这四大坐标系之间的位置关系,得到了它们之间的坐标转换矩阵,可以将三维空间中任意一点通过坐标变换转换到二维成像平面上。分析双目测距的原理,得出距离的计算公式,然后简单介绍了几种典型的立体匹配算法,为实现双目立体视觉测距提供了基础。

(3)对GA-Net立体匹配算法的网络结构和实现过程进行剖析,使用该立体匹配算法对选取的批量图像数据集进行处理,获取视差图。将其得到的立体匹配得到的视差图与通过SGM立体匹配算法得到的视差图进行对比分析,证明了GA-Net立体匹配算法得到的视差图具有更好的的匹配效果,从而可以提高通过视差信息计算距离的准确度。

(4)研究分析了YOLOv4实时目标检测算法的检测过程,检测原理、网络结构和损失函数,在标准数据集中选择所需的标签信息,采用YOLOV4网络进行重新训练,最终得到的目标检测的m AP为47 %,每30 ms左右可以检测完成一张图片。在相同环境下对SSD目标检测模型的效果进行测试并与YOLOv4进行对比。得到了图像中目标的位置信息,为目标的距离计算做了准备工作。

(5)搭建双目立体试验平台。选择张正友标定法,基于MATLAB双目立体相机标定工具对系统选用的双目相机进行标定,得出双目相机的内部参数和外部参数。采集视频图像信息,截取其中关键帧,首先采用单目标检测与测距的实验方案,得出图像中目标的类别和距离,共进行了15组实验,然后将计算得出的距离与激光测距仪测量的距离进行对比,分析误差。得出在15 m范围之内误差控制在5.2 %左右。然后在不同场景下进行多目标的检测与测距试验,实现了不同场景下多目标的检测与测距。试验表明本文能够对自动驾驶的汽车提供车辆前方的信息。

参考文献.

[1]杨铖汽车电子技术中的智能传感器技术分析[J]电子测试20212)133-134.

[2] THORPE C, HERBERT M KANADE T, et al. Toward autonom ous driving the cmu navlab.11. architecture and systems[]. IEEE expet, 1991, 6(4): 44-52.

[3] MALLOT H A BULTHOFF H H, LITTLE JJ, et al. Inverse perspective m apping simplifies optical flow cam putaton and obstacle detection[]. Biologcal cybemetics, 1991, 64(3):177-185.

[4] NGUYEN V D, VAN NGUYEN H, TRAN D T, et a1. Leamning fram ework far robust obstacle detection, recognition and tracking[J]. IEEE Transactions an Inteligent Transpotati on System器2016, 18(6): 1633- 1646.

[5] SEO D, PARK H, JO K et al. Omni directional stereo vi sian based vehicle detection and di st ance m easu ement for diver assi stance system [C]/IECON 2013- 39th Annua1 C onference of the IEE Industrial E1ectr anics Society IEEE, 2013: 5507-5511

[6]王荣本李琳辉,金立生郭烈,赵-兵基于双目视觉的智能车辆障碍物探测技术研究[]中国图象图形学报,2007(1 2):2158-2163.

[7]齐小燕基于双目立体视觉V-视差法障碍物检测算法研究与实现[D]沈阳:东北大学,2010.

[8] 张琦,胡广地,李雨生,赵鑫.改进FastRCNN 的双目视觉车辆检测方法[]应用光学,2018,39(6) 832-838.

[9] 岳欣羽基于双目视觉的车辆前方障碍物检测方法研究[D].吉林:吉林大学, 2018.

[10]MART D C. A computati onal investigation into the human repr esentation and processing of vi sual inform ati on[J]. Free-nan, San Francisco, CA, 1983,27(1)

[1 1]BOYKOV Y, KOLMOGOROV V. An experim ental comparison of min- cutmax flow algorithms for energy mininization in vision[J]. IEEE tr ansactions on pattern analysis andm achine inelligence, 2004, 26(9): 1124-1137.

[12]LEMPITSKY V, ROTHER C, BLAKE A. Logcut- ef cient egraph cut optimizati on for m arkov random fieldsC]/2007 1EEE 1 1th Intermnati onal C onference on C amputer Visan. IEEE, 2007: 1-8.

[13]KANADE T, KANO H, KIMURA S,et al. Development of a video-rate stereom achine[C]Proceedings 1995 IEEERSJ Internati anal C onference on Intelligent Robots and System s. Hum an R obot Inter acti on and C ooperative Robots. IEEE, 1995, 3: 95-100.

[14]HIRSCHMULLER H Accurate and ef cient stereo proce sing by semi-global m atching andm utual inform atian[C]/2005 IEEE C om puter Society C anference on Computer Vision and P ttermn Recogiti on (CV PR05). IEEE, 2005, 2:807-814.

[15]ZBONTAR J, LECUN Y. Computing the stereo mnatching cost with a convolutional neural network[C]/Proceedings of the IEEE canfer ence an computer vi si arn and pattern recognition2015: 1592-1599 .

[16]CHANG J R, CHEN Y s. Pyramid stereo m atching netw ork[C ]/Proceedings of the IEEEC onference on C am puter Vison and P atern Recogntion 2018: 5410-5418.

[17]ZHANG F, PRISACARIU V, YANG R, et al. G a net: Guided aggregation net for end to- eand stereo matching[C]/Proceedings of the IEEE/CVF C anference an C omputer Vision andP atern Recognition 2019: 185- 194.

[18]GIRSHICK R, DONAHUE J, DARRELL T, et al. Rich feature hi erar chi es for accurate obj ect dection and semartic segm ention[C]/Proceedingsg of the IEEE conference on computer vis an and pattern recogntion. 2014: 580-587.

[19]HE K ZHANG X REN s, et al. Spatial pyramnid pooling in deep convoluti onal netwv orks far vi sual recognition[J] IEE tansactions on pattern analysis and m achine itligence, 2015,37(9) 1904-1916.

[20]GIRSHICK R. F ast r-cn[C]/Proceedngsg of the IEEE intemnati onal confer ence on computer vision.2015: 1440-1448 .

[21]REN s, HE K GIRSHICK R, et al. Faster 1 cnmn: Tow ards real time obj ect detection with regon p oposal netwv arks[]J arXiv preprint aXiv.1506 01497,2015.

[22]REDMON J, DIVVALA S, GIRSHICK R, et al. You anly look once: Unified re al-timne object dete cti an[C]/Proceedings of the IEE conference on computer vision and pattern recogniti on.2016: 779-788 .

[23]LIU W, ANGUELOV D, ERHAN D, et al. Ssd: Single shot multibox detecta[C]/European conference on com puter vi sion. Springer, Cham, 2016: 21-37.

[24]REDMON J, FARHADI A Y0LO9000: better, fastr, st anger[C]/P roceedings of the IEEE conference on com puter vi si on and pattern recognition. 2017: 7263-7271.

[25]REDMON J, FARHADI A Yolov3: An incremental improvem en[] arXiv pr eprint arXiv1 804.02767, 2018.

[26]BOCHKOVSKIY A, WANG C Y, LIAO H Y M. Yolov4: Optim al speed and accuracy of object detectian[J]. aXiv preprint arXiv.2004. 10934, 2020.